今回は意外と難しいロジスティック回帰と最尤推定法について解説します。

最尤推定法についてはこちらをご覧ください。

線形回帰分析と最尤推定法についてはこちらをご覧ください。

また、ロジスティック回帰のコードはこちらをご覧ください。

ロジスティック回帰分析

ロジスティック回帰は、0,1の2値を取るデータを分類する問題を解くときに使用するモデルです。

yiを目的変数、xikを説明変数とすると、ロジスティック回帰は以下のように表すことができます。

yi=1+exp(−(β0+β1xi1+β2xi2+⋯+βKxiK))1

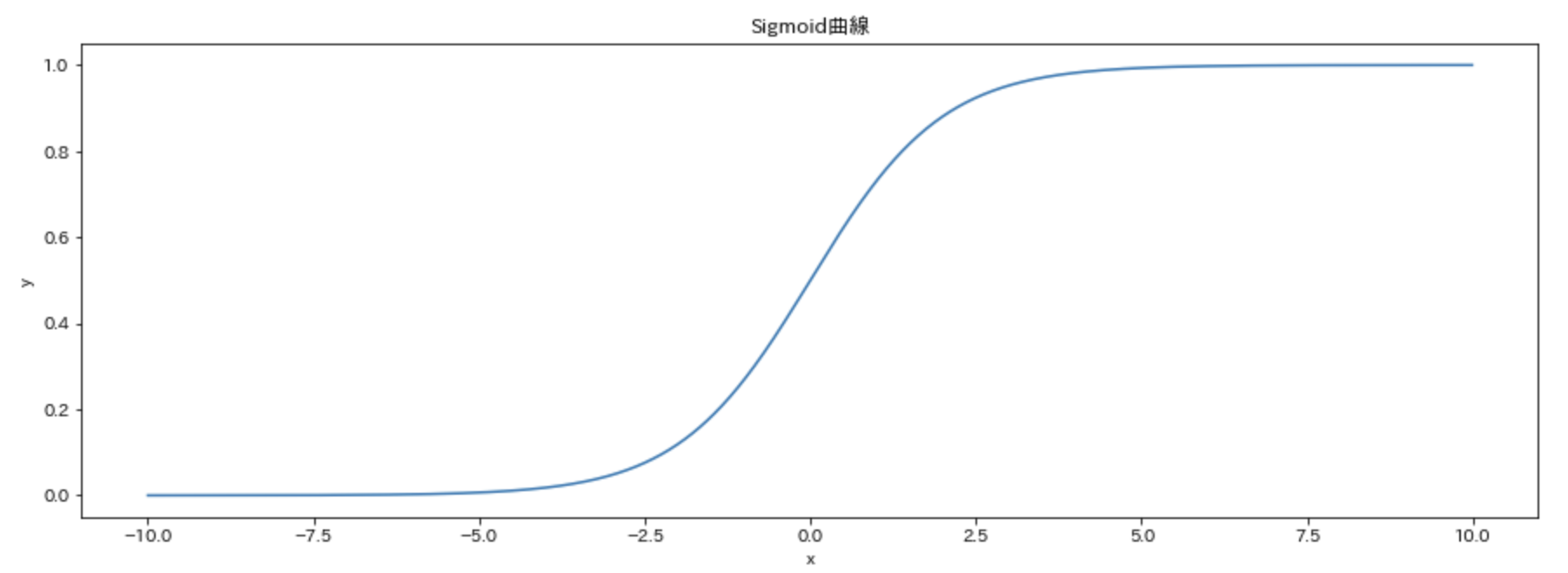

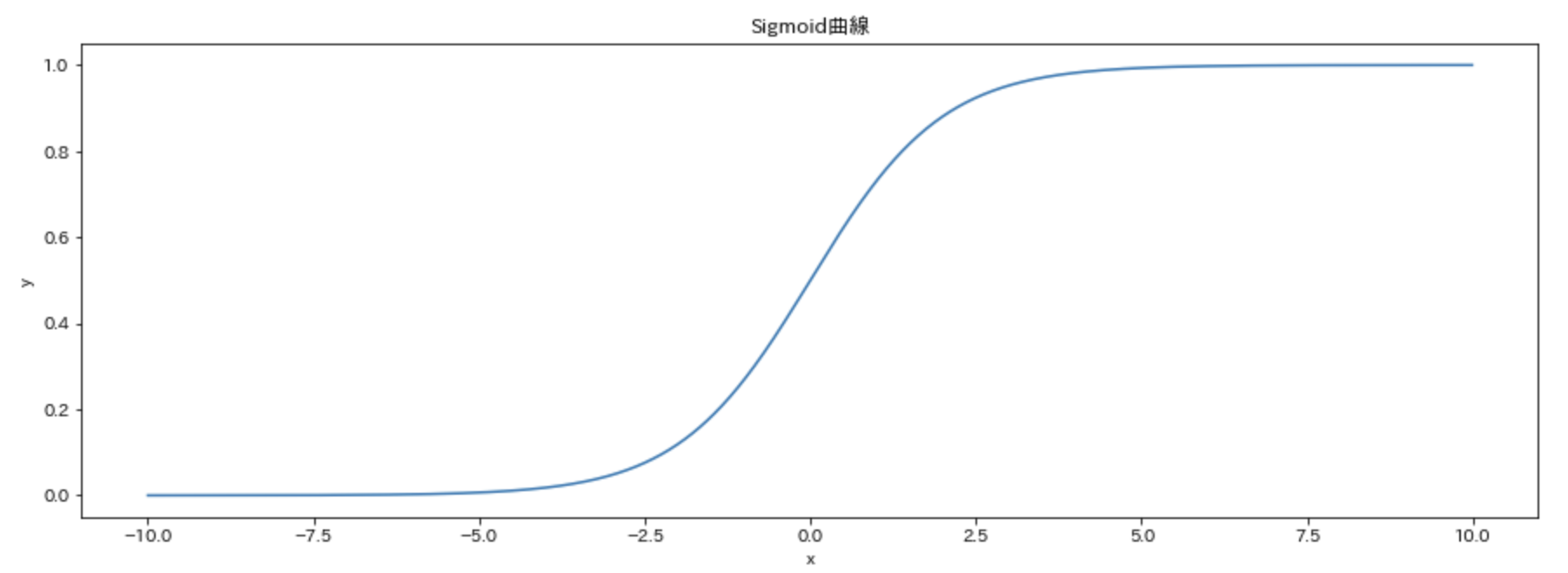

また、シグモイド関数を以下の式で定義します。

σ(x)=1+exp(−x)1

シグモイド関数は0から1の値を取り、以下のような関数です。

この関数を使うと、ロジスティック回帰は以下のように書くことができます。

yi=σ(β0+β1xi1+β2xi2+⋯+βKxiK)

シグモイド関数の性質からyiは0から1の値を取るため、0,1の2値を表す確率変数Ciを用いて以下のように定義することができます。

P(Ci=1∣xi1,⋯,xiK)P(Ci=0∣xi1,⋯,xiK)=yi=1−yi

上記をまとめると、データiの実現値をti(0か1の2値をとる)として以下のように書くことができます。(tiに0と1を入れると上の式になることが確認できます。)

P(Ci=ti∣xi1,⋯,xiK)=yiti(1−yi)1−ti

ロジスティック回帰と最尤推定法

※以下では、文字を太字で書いた場合にはベクトルを表すことにします。(たとえば、x=(x11,x12,⋯,xnK)を表します。)

この章では、パラメータβを最尤推定法を用いて求めます。

その前に、最尤推定法のおさらいです。

(離散確率分布における)最尤推定法は、「パラメータをいろいろ変えて今あるデータで確率を出してみて、確率が最も高いものをもとのパラメータとしよう」という考えのもと推定していきます。当然パラメータは無限の可能性がありいちいち代入していられないので、パラメータを変数とみた関数を考え、確率が最大となるパラメータを最尤推定値とします。このパラメータを変数とみた関数を尤度関数といいます。

パラメータはβであることとデータが独立であることを考えると、尤度関数Lは以下のように算出することができます。

L=P(C0=t0,⋯,Cn=tn∣x,β)=i=1∏nP(Ci=ti∣xi,β)=i=1∏nyiti(1−yi)1−ti

このままでは計算しづらいので、対数を取って対数尤度関数を求めます。(対数は単調増加関数なので、尤度関数が最大となるパラメータは対数を取る前と後で変化することはありません。)

logL=i=1∑n{tilogyi+(1−ti)log(1−yi)}

パラメータβの最尤推定値を求めるためには、対数尤度関数が最大となるβを求めます。

ここで機械学習では、最適化をする場合は損失関数を定義し、最大化ではなく最小化を目指す慣習があります。

従って、対数尤度関数にマイナスをかけて損失関数を定義します。

E=−i=1∑n{tilogyi+(1−ti)log(1−yi)}

この損失関数を交差エントロピー誤差と呼びます。これを最小にするパラメータβを求めます。

交差エントロピー誤差について

交差エントロピー誤差を詳しく見ていきます。

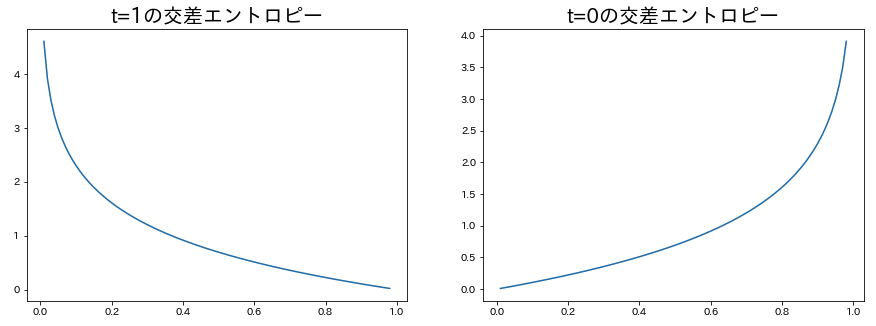

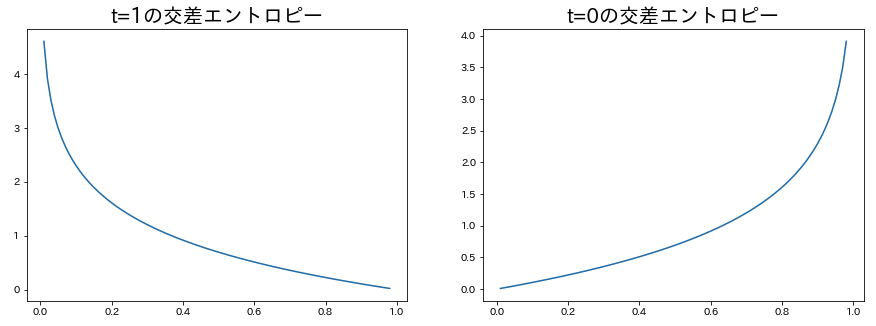

データiの交差エントロピーをEiと書くと、tiは0と1しか取らないことから、以下のように書くことができます。

Ei={−logyi−log(1−yi)(ti=1)(ti=0)

ti=0,1のグラフをそれぞれ書いてみると以下のようになります。

ここから、以下のことがわかります。

- ti=1のときは予測確率が1に近いほど損失関数の値が小さい。

- ti=0のときは予測確率が0に近いほど損失関数の値が小さい。

損失関数を最小化するということは、上記を目指すことと一致します。

交差エントロピー誤差の最小化

さて、交差エントロピー誤差が最小となるパラメータβを求めるため、偏微分していきましょう。

∂βk∂E=−i=1∑n∂βk∂{tilogyi+(1−ti)log(1−yi)}

シグマの中身の微分を一つずつ処理していきます。

まずは、∂βk∂logyiを計算します。

zi=β0+β1xi1+β2xi2⋯βkxikとおくと、yi=σ(zi)であり、 σ(x)′=(1+e−x1)′=(1+e−x)2e−x=1+e−xe−x⋅1+e−x1=(1−σ(x))σ(x) に注意すると、以下のように変形できます。

∂βk∂logyi=yi1∂βk∂yi=yi1∂βk∂zi∂zi∂σ(zi)=yi1xik(1−σ(zi))σ(zi)=yi1xik(1−yi)yi=(1−yi)xik

次に、∂βk∂log(1−yi)を計算します。計算はほぼ上記と同じです。

∂βk∂log(1−yi)=−1−yi1∂βk∂yi=−1−yi1(1−yi)yixik=−yixik

以上の計算結果を使うと、交差エントロピー誤差の偏微分は以下のようになります。

∂βk∂E=−i=1∑n∂βi∂{tilogyi+(1−ti)log(1−yi)}=−i=1∑n{ti(1−yi)xik+(1−ti)(−yixik)}=−i=1∑n(ti−yi)xi=i=1∑n(yi−ti)xik

とても綺麗な式になりました。

ここから偏微分=0となるβを求めたいですが、解析的には解くことができません。

そこで、勾配降下法を用いてβを求めます。

勾配降下法は以下の式を使用してβkを更新します。αは学習率です。

βk←βk−α∂βk∂E

学習率αを入れないで通常の偏微分を引いてしまうと、引く幅が大きくなってしまい、収束しません。 従って、α=0.01などを入れて引く幅を小さくします。

また、∂βk∂E=∑i=1n(yi−ti)xikはデータ数に依存して大きくなってしまうので、 実際には代わりにデータ数で割ったn1∑i=1n(yi−ti)xikを引くことも多いです。 (定数で割ることは更新幅のみに影響するので問題ありません。) 後ほど紹介するコードではデータ数で割った式で更新しています。

パラメータの更新は、交差エントロピー誤差がほとんど動かなくなったら終了です。

なお、厳密には勾配降下法で求めることができるのは極小値です。最小値であることは、損失関数の凸性を示す必要があります。

ここでは証明しませんが、交差エントロピー誤差は凸であることが知られていますので、勾配降下法で最小値を求めることができます。

実際の結果

勾配降下法を用いてロジスティック回帰を回した結果はこのコードを実行してみてください。

まとめ

ロジスティック回帰と最尤推定法に関してまとめました。

交差エントロピー誤差を知っている方は多いかもしれませんが、 なぜ交差エントロピーが使用されているかは最尤推定法を学ぶと理解できるかと思います。

最尤推定法は統計的手法のあらゆる箇所で使用されているので、今後も紹介できたらなと思います。